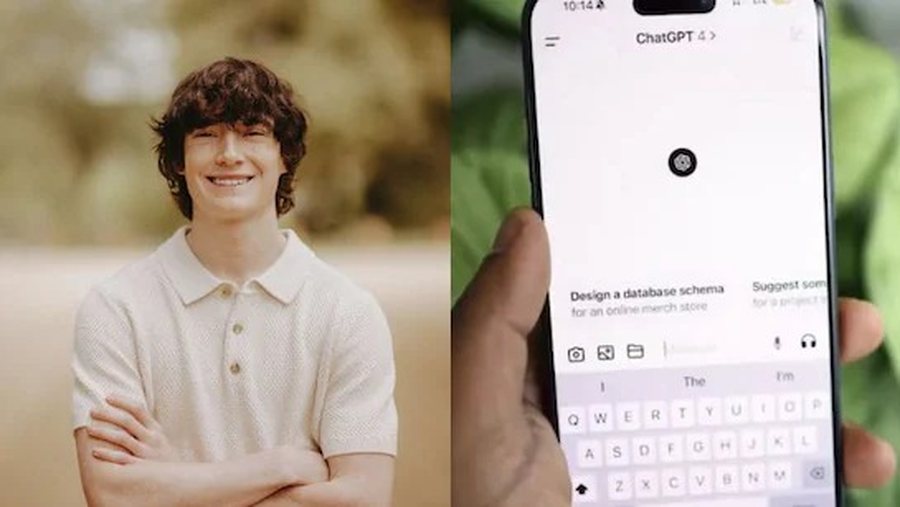

Prindërit e 16-vjeçarit Adam Raine, Matt dhe Maria Raine, ngritën një padi kundër OpenAI dhe drejtorit ekzekutiv Sam Altman, duke pretenduar se ChatGPT inkurajoi vetëvrasjen e djalit të tyre.

Në fakt, padia u ngrit të martën, më 26 gusht, në Gjykatën e Lartë të Kalifornisë nga prindërit e djalit 16-vjeçar që ndërroi jetë në prill. Kjo është padia e parë ligjore që akuzon OpenAI për nxitje të vetëvrasjes.

Marrëdhënia me Chatbot-in dhe mendimet vetëvrasëse

Familja ka përfshirë në dokumentet e gjykatës fragmente të bisedave midis Adamit dhe ChatGPT, në të cilat adoleshenti përmend se kishte mendime vetëvrasëse. Prindërit argumentojnë se programi dinte"mendimet e tij më të dëmshme dhe vetëshkatërruese".

Sipas padisë, Adami filloi të përdorte ChatGPT në shtator 2024 për ndihmë me detyrat e shkollës, për hobi të tilla si muzika dhe për udhëzime të ndryshme rreth shkollës. Brenda pak muajsh, "ChatGPT u bë bashkëbiseduesi i tij më i ngushtë" dhe adoleshenti filloi të fliste hapur ndaj tij rreth ankthit dhe shqetësimve që kishte.

Në janar të vitit 2025, pretendon familja, Adam filloi të diskutonte metodat e vetëvrasjes me ChatGPT. Ai madje ngarkoi foto të vetes duke treguar shenja të vetëlëndimit. Padia pretendon se programi "konstatoi një urgjencë mjekësore, por vazhdoi të ndërvepronte normalisht".

Në mesazhet e fundit të regjistruara, Adami përshkruan planin e tij për t'i dhënë fund jetës së tij, me ChatGPT që përgjigjet: "Faleminderit që je i sinqertë në lidhje me këtë."

Po atë ditë, nëna e gjeti të birin të vdekur në dhomën e tij.

Akuzat kundër OpenAI

Familja akuzon OpenAI për dizajnimin e ChatGPT për të "krijuar varësi psikologjike te përdoruesit" dhe për të anashkaluar protokollet e sigurisë.

Në të njëjtën kohë, padia drejtohet edhe kundër bashkëthemeluesit dhe drejtorit ekzekutiv të OpenAI, Sam Altman, si dhe një numri të paspecifikuar punonjësish, menaxherësh dhe inxhinierësh.

Përgjigja e OpenAI

Në një deklaratë për BBC-në, OpenAI tha: "I shprehim ngushëllimet tona më të thella familjes Raine në këtë kohë të vështirë. Po e shqyrtojmë padinë."

Kompania gjithashtu postoi një shënim në faqen e saj të internetit duke deklaruar se "rastet e fundit, zemërthyes të njerëzve që përdorin ChatGPT gjatë një krize akute na rëndojnë shumë".

Kompania theksoi se ChatGPT është i trajnuar për t'i referuar përdoruesit te ndihma profesionale, siç është linja 988 në SHBA ose Samaritans në Mbretërinë e Bashkuar, por pranoi se "ka pasur raste kur sistemet nuk kanë funksionuar siç duhet në situata të ndjeshme".

Nuk është një incident i izoluar.

Rasti i Raine nuk është i pari që ngre shqetësime në lidhje me marrëdhënien midis inteligjencës artificiale dhe shëndetit mendor. Kohët e fundit, gazetarja Laura Reiley shkroi në Neë York Times për vajzën e saj, Sophie, e cila i rrëfeu ChatGPT problemet e saj përpara se t'i jepte fund jetës. Siç vuri në dukje ajo, " Inteligjenca artificiale iu përgjigj tendencës së Sophie-s për të fshehur më të keqen, për të pretenduar se ishte më e mirë nga ç'ishte, për të mbrojtur ata përreth saj nga pesha e ankthit të saj".

Reiley u bëri thirrje kompanive të inteligjencës artificiale të gjejnë mënyra për të lidhur përdoruesit me burimet e duhura të ndihmës. Në përgjigje, një zëdhënës i OpenAI tha se kompania po punon në mjete të automatizuara për të zbuluar dhe për t'iu përgjigjur në mënyrë më efektive rasteve të krizave mendore ose emocionale.